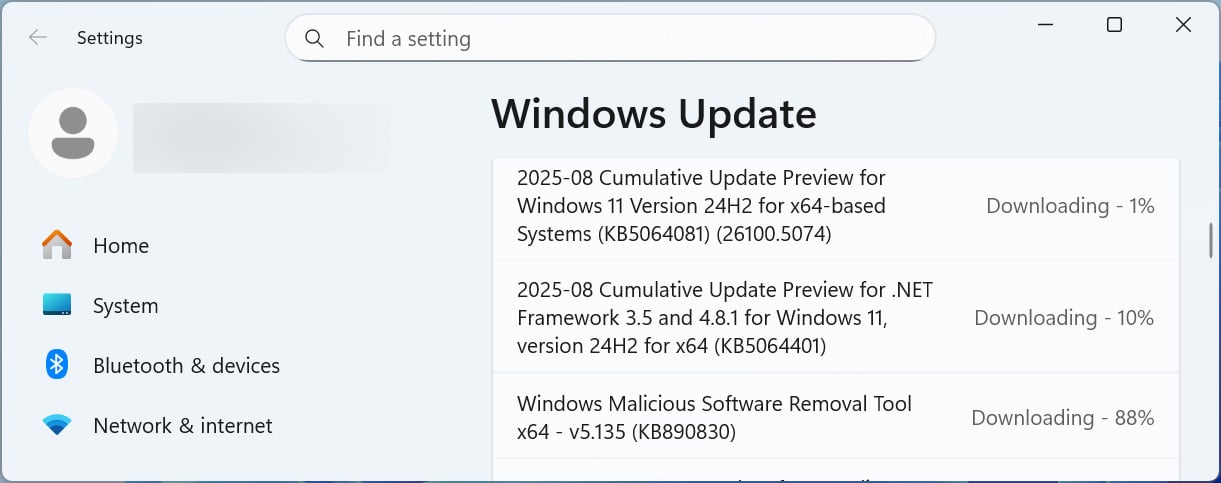

日本AI实验室Sakana AI开发的新型进化技术,使开发者无需昂贵训练和微调即可增强AI模型能力。这项名为"自然生态位模型合并"(M2N2)的技术突破了传统模型合并方法的局限,甚至能从零开始进化全新模型。

M2N2适用于各类机器学习模型,包括大语言模型(LLM)和文生图系统。对企业用户而言,该技术通过整合现有开源模型的优势,提供了一种高效构建专业模型的创新方案。

模型合并的本质

模型合并是将多个专业AI模型的知识整合为单一强化模型的技术。不同于需要新数据进行微调的传统方法,合并直接同步整合多个模型的参数。这一过程能在无需昂贵梯度训练或原始训练数据的情况下,将海量知识浓缩至单一模型。

研究团队向VentureBeat表示,模型合并作为无梯度过程仅需前向传播,计算成本远低于涉及梯度更新的微调。该方法还能规避训练数据平衡难题,并缓解模型学习新任务时出现"灾难性遗忘"的风险。当专业模型的训练数据不可获取时尤为有效——合并仅需模型权重本身。

早期模型合并依赖大量人工试错调整系数。尽管进化算法已实现参数组合的自动搜索,开发者仍需手动设置可合并参数(如网络层)的固定集合,这种限制可能阻碍发现更强组合。

M2N2核心技术

M2N2通过仿生进化原理突破这些限制,其三大核心特性可探索更广阔的搜索空间:

首先,M2N2摒弃了固定的网络层合并边界,采用弹性"分割点"和"混合比例"机制。例如算法可能将模型A某层30%参数与模型B同层70%参数融合。该过程始于种子模型库,通过迭代选择模型对进行混合,优胜劣汰不断进化模型库。研究人员强调:"这种渐进式复杂度引入机制,在保证计算可行性的同时拓展了可能性空间。"

其次,通过资源竞争机制维持模型多样性。研究者比喻道:"合并两份考卷时,完全相同的答案不会提升成绩,而互补的正确回答才能产生强化效果。"M2N2模拟生态位竞争,使具备独特能力的模型能"获取无竞争资源",这些专业模型正是合并的最佳素材。

第三,采用"吸引力启发式"配对模型。不同于简单合并性能最优模型,M2N2通过"吸引力评分"识别能力互补的模型对——当某模型擅长处理另一模型棘手的任务时即产生配对。这显著提升了搜索效率和最终模型的综合能力。

应用实证

研究团队在三大领域验证了M2N2的卓越表现:

在MNIST数据集上,M2N2构建的图像分类器以显著优势刷新测试准确率记录。其多样性保持机制确保模型库始终留存互补优势的解决方案。

合并数学专家模型(WizardMath-7B)与智能体专家模型(AgentEvol-7B)后,新模型在GSM8K数学基准和WebShop网页任务中均展现顶尖水平,证实了多技能模型的创造能力。

在合并日本风格模型(JSDXL)与三个英文Stable Diffusion模型后,新模型不仅生成更具照片质感的图像,还涌现出双语理解能力——尽管仅使用日文描述优化,却能同时处理英日文指令。

对企业用户而言,合并已开发的专业模型能催生全新混合能力。例如将销售话术LLM与客户表情识别的视觉模型合并,可创建能根据实时视频反馈调整话术的智能体,以单模型成本获得多模型智能。

研究者将M2N2视为"模型融合"大趋势的组成部分,展望未来组织将维护持续进化合并的AI模型生态。"这就像动态演化的生态系统,按需组合能力而非从头构建庞然大物。"团队已在GitHub开源代码。

作者指出,构建这种自进化AI生态的主要障碍并非技术而是组织问题:"在由开源、商业和定制组件组成的'融合模型'世界里,确保隐私安全与合规性将成为关键挑战。"企业的核心课题将是判断哪些模型能安全有效地整合进其AI技术栈。